El futuro de los sistemas

La informática distribuida es uno de los conceptos que marcarán un antes y un después en la forma de compartir recursos. La idea nació en los entornos científicos y universitarios y, sus máximos exponentes son proyectos relacionados con la biotecnología y el análisis de datos.

Los grandes fabricantes como IBM y Sun no se están quedando atrás en el campo de la informática distribuida, aunque su visión es muy distinta. Tanto Sun como IBM, al igual que HP y Compaq, ya fusionadas, e incluso Microsoft, forman parte del Global Grid Forum, un foro cuya misión consiste, según Cecile Eguizábal, responsable del área de Volume Product en Sun Microsystems Ibérica, en la promoción y creación de tecnologías y aplicaciones grid a través del desarrollo y la documentación de la mejores prácticas, instrucciones de implementación y de los estándares, con especial énfasis en el código de ejecución. Sun forma parte de este foro, al igual que IBM, con el fin de impulsar los estándares para la crucial e importante capa de la gestión de los recursos distribuidos (DRM). Entre otras cosas, Sun se encuentra trabajando en un proyecto del Global Grid Forum, llamado DRAMA (Distributed Resource Management Application API), para crear una interfaz estándar para el DRM, que permitirá a los vendedores de software independientes (ISV) crear aplicaciones para grid.

Para la responsable de Sun, es necesario dintinguir entre varios tipos de informática distribuida o informática al servicio de la informática. "Nosotros diferenciamos entre la denominada Global, la Campus y la de tipo Cluster. La tecnología utilizada para Campus Grids y Cluster Grids, el 95 por ciento del mercado actual, ya está madura, pero los Global Grids, que están diseñados para dar soporte a múltiples organizaciones que comparten recursos de computación, no están listos. Las compañías comerciales no quieren poner la información de su diseño en Internet".

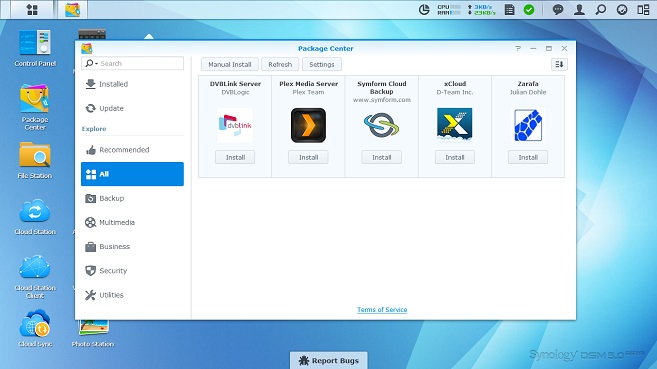

La virtualización de los recursos permite asignar procesadores y memoria a las diferentes tareas que realiza el servidor para así asegurar el rendimiento adecuado de las funciones más críticas del sistema. Así, Compaq ha desarrollado una herramienta para la gestión de los recursos que permite la consolidación de la carga de trabajo sobre servidores ProLiant de Compaq, Compaq Workload Management Pack, que incrementa la estabilidad y disponibilidad de las aplicaciones bajo Windows 2000, además de permitir a los clientes implantar múltiples aplicaciones de forma fiable en un único servidor. La característica más importante de esta aplicación es la posibilidad de alterar dinámicamente la asignación de memoria y procesadores a una partición de recursos.

La arquitectura de la aplicación está formada por un interface y servicios. El interface permite al administrador crear y activar fácilmente una partición de recursos definiendo los procesadores requeridos, las propiedades asociadas y las reglas de la partición de recursos. El motor de reglas incluido en el servicio proporciona el mecanismo para alterar dinámicamente los recursos de memoria y procesadores reservados. Si las condiciones externas al servidor cambian y un proceso necesita más recursos, el motor de reglas ejecuta las reglas definidas cuando la partición fue creada.

Tendencias en almacenamiento

Los directores de Sistemas de Información, bajo una presión creciente por reducir gastos, no pueden permitirse tener enormes cantidades de espacio no utilizado, ni contratar a nuevos especialistas en gestión de almacenamiento.

La situación, de por sí bastante mala en un entorno mainframe con sólo un sistema operativo y uno o dos tipos de almacenamiento físico, se hace más complicada en un sistema de almacenamiento en red con conjuntos de discos, switches, adaptadores de bus de host y sistemas operativos de servidor procedentes de una multitud de empresas diferentes.

Las empresas que tienen en funcionamiento sistemas distribuidos como Unix o Windows gestionan con frecuencia la misma cantidad de datos que antes solía encontrarse sólo en un mainframe. En un entorno distribuido, carecen de las sofisticadas herramientas de gestión de datos que permiten a los directores de sistemas mainframe predecir y monitorizar el aumento del almacenamiento para utilizar de forma óptima su espacio en discos.

Debido a la falta de herramientas, los directores de sistemas tienen que gastar un dinero adicional para adquisiciones, ofrecer soporte técnico y monitorizar múltiples herramientas de control del almacenamiento para varios tipos de aplicaciones, hardware de almacenamiento o sistemas operativos de servidor. También es más difícil configurar su almacenamiento para aumentar al máximo su fiabilidad, rendimiento y tolerancia a fallos.

Niveles

La gestión del almacenamiento puede dividirse en diferentes niveles de capacidades. El primero es la Gestión de Recursos de Almacenamiento o SRM (Storage Resource Management). A este nivel, las herramientas simplemente mantienen un "mapa" de los dispositivos de almacenamiento físicos y lógicos existentes y muestran la forma en que están siendo utilizados. Aunque la gestión SRM ha alcanzado bastante madurez en entornos mainframe