Proyecto E-Motions o aunar tecnología y emociones humanas

Aunque hoy suene a ciencia ficción, la llegada al mercado de terminales electrónicos capaces de percibir los sentimientos y estados de ánimo de sus usuarios con el fin de mejorar su servicio y proporcionar ofertas de sus productos más personalizadas y ajustadas al perfil de cada cliente, está cerca. Tan sólo faltan tres años para que una de las iniciativas que existen en este campo esté lista. Se trata de E-Motions, proyecto en el que trabajan el Centro de Sistemas de Medios Integrados (IMSC) de la Universidad del Sur de California y la compañía de almacenamiento de datos, Teradata.

En este sentido, mediante tecnologías de reconocimiento facial, los cajeros podrían detectar, por ejemplo, que el usuario entorna los ojos porque le moleste el sol o se le hayan olvidado las gafas, lo que solventaría ajustando la pantalla o aumentando el tamaño de las letras. Asimismo, sería posible si se percibe que el usuario está confundido, que el terminal le proporcione un menú de ayuda. “El sistema –señala Süelzer- puede ayudar a los procesos de CRM (gestión de la atención al cliente) ya que los terminales podrán ajustarse mejor a la demanda de los consumidores. Y, dado que las emociones son difíciles de controlar, esto se puede hacer”.

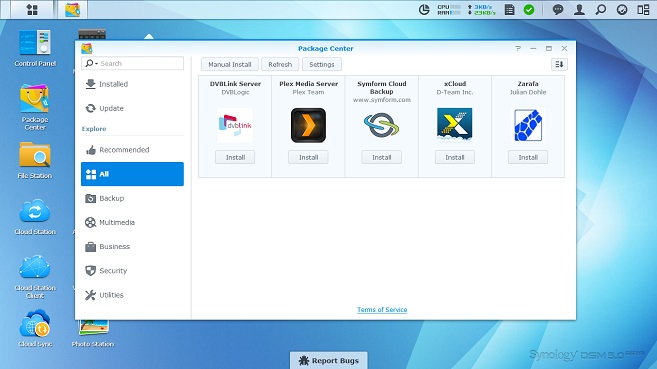

Sistema InmersiPresence

El denominado InmersiPresence o sistema experimental de presencia inmersiva, es una de las aplicaciones del proyecto E-Motions. Éste crea una representación virtual en tres dimensiones de una persona que puede responder en tiempo real, lo que permite que se lleven a cabo videoconferencias donde se ven todos los movimientos y expresiones de los participantes, en vez de visualizar el mismo plano de la persona mirando a la cámara de la videoconferencia.

Gracias a la combinación de este sistema y las bases de datos y software CRM de Teradata (donde se almacena la información que se obtiene de los gestos de los usuarios) los anunciantes de productos podrán, además, medir los resultados de sus campañas, manifiesta Süelzer.

Teradata trabaja en el proyecto E-Motions desde 1997 y es senior parter del mismo, habiendo invertido una gran suma, según el responsable de la compañía en EMEA. Por su parte, el IMSC basa sus investigaciones en la creencia de que la red del futuro no será tal y como hoy la conocemos, sino que se desarrollará en un entorno en el que participen todos los sentidos humanos, no sólo los visuales y táctiles a través de los teclados actuales.